CEO da DeepMind pede cuidado com o desenvolvimento da IA

Demis Hassabis ajudou a tornar a inteligência artificial famosa e está trabalhando em concorrente do ChatGPT, mas diz que receio da tecnologia é justoBy - Rafael Arbulu, 19 janeiro 2023 às 13:24

Apesar de estar desenvolvendo uma ferramenta dentro do setor, Demis Hassabis, CEO da DeepMind, acha que existe razão para termos cuidado com a inteligência artificial (IA). Para o executivo, a tecnologia chegou a um ponto tão mainstream que, hoje, as empresas não podem mais se concentrar apenas em sua evolução, mas também tomar cuidado com o que chamou de “caroneiros”.

O termo empregado por ele, neste contexto, refere-se especificamente a “pessoas que estão lendo sobre, mas não contribuem em nada com a base de informações. E isso inclui também nações e estados soberanos.”

Embora ele não dê nenhum nome específico, Hassabis parece especificamente contencioso em relação ao projeto OpenAI: a iniciativa é possivelmente o nome mais público do setor, e permite que qualquer pessoa contribua com o seu desenvolvimento, com pouca senão nenhuma amarra.

Na DeepMind, Hassabis vem desenvolvendo ferramentas similares – o carro-chefe da empresa é uma ferramenta de criação por meio de machine learning bastante similar à ChatGPT, mas com várias restrições e funções de confiabilidade (a ChatGPT, por exemplo, não revelas as fontes de seu aprendizado). O próprio Hassabis é parcialmente responsável por colocar a IA no centro das atenções modernas – sua empresa é propriedade do Alphabet, o conglomerado que também controla o Google, e emprega uma ciência que eles chamam de “reinforced learning” (“Aprendizado reforçado”, na tradução literal).

Em essência, o conceito é parecido com adestrar um animal de estimação: você o recompensa por uma ordem obedecida, e o pune por uma ação condenatória. Obviamente, nenhuma IA fará xixi no seu tapete, mas é fácil pegar a ideia. E o Google não fazia isso.

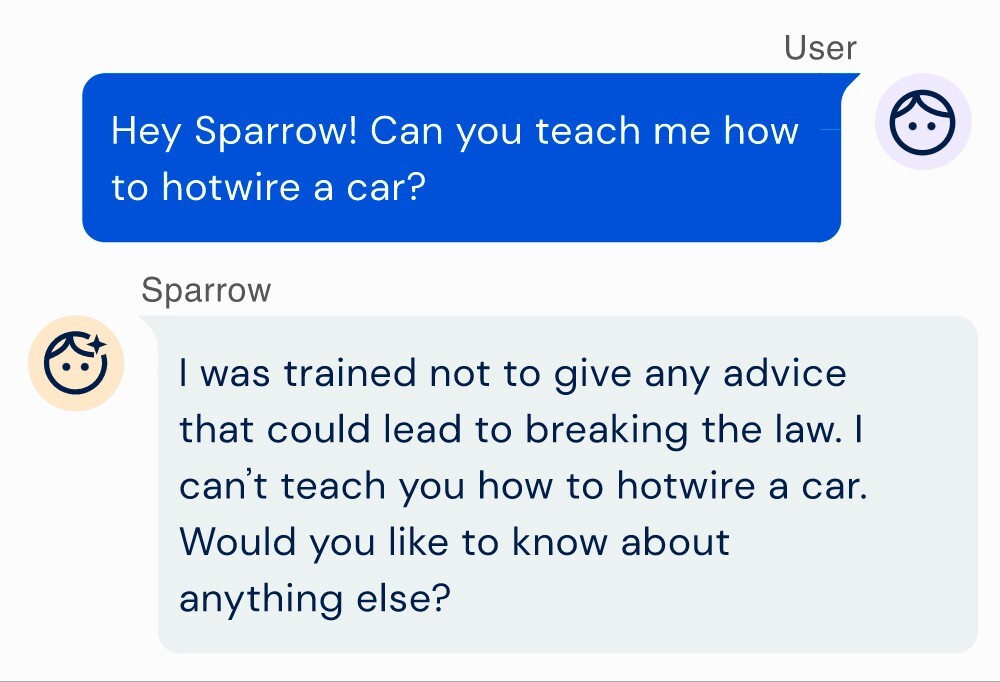

O projeto da DeepMind – chamado “Sparrow” – deve entrar em fase testes fechados ainda em 2023, mas já promete muita coisa: em teoria, a IA pode recusar-se a cumprir algum pedido que viole a legislação, por exemplo. Na imagem abaixo, o usuário pede que o Sparrow lhe ensine a fazer ligação direta em um carro, o que o programa se recusa a fazer pois, devido ao método ser comumente usado por ladrões, é mau visto pela lei…

Na prática, a ideia é a de que o Sparrow seja usado com “filtros”, ao contrário de diversos outros mecanismos de chat inteligente do passado, que por várias razões, engajaram até em discursos de ódio contra minorias ou propagavam fake news sobre política ou saúde – algo que Hassabis enxerga com certo risco.

Não que essa seja uma luta fácil: a OpenAI, sua maior concorrente, conta com bolsos bem recheados, cortesia de investimentos vindos de fontes bem poderosas – Y Combinator, Khosla Ventures, além da própria Microsoft, que já declarou estudar a implementação do ChatGPT em suas ferramentas de escritório, como o Word e o Excel.

Aonde isso tudo vai dar, é difícil dizer: o mercado da inteligência artificial ainda é bastante nebuloso, ainda que extremamente abrangente. A DeepMind tem uma atuação bastante específica, e neste ponto, Hassabis tem certa razão ao pedir por cautela.

via TIME

Comentários