Por trás do Projeto Starline: como funcionam as ‘conversas holográficas’ do Google

Desenvolvido pela big tech, sistema de telepresença permite realizar videoconferências em 3D; veja mais detalhes sobre como funcionaBy - Tissiane Vicentin, 6 dezembro 2021 às 17:11

Em um novo relatório, o Google apresentou detalhes por trás da tecnologia holográfica do seu intrigante Projeto Starline, cujo lançamento deve marcar uma [r]evolução na dinâmica de interação de conversas online que conhecemos até hoje.

A novidade já havia sido apresentada em maio, quando a empresa liberou o primeiro teaser para demonstrar como o projeto deve funcionar na prática.

A princípio, o principal objetivo que o Google teria com os bate-papos virtuais é torná-los mais próximos da realidade, como se fossem “conversas holográficas”, no melhor estilo Star Wars, mas sem a transparência característica de hologramas.

“É o mais perto que podemos chegar da sensação de que a pessoa está à nossa frente, em uma mesa”, disse Pichai, ao apresentar a tecnologia durante o evento anual para desenvolvedores Google I/O 2021, em maio.

Conversa holográfica e a telepresença

Uma das principais tecnologias aceleradas pela pandemia foi a telepresença – seja por conta dos atendimentos de saúde, seja para possibilitar reuniões dinâmicas entre pares nas empresas.

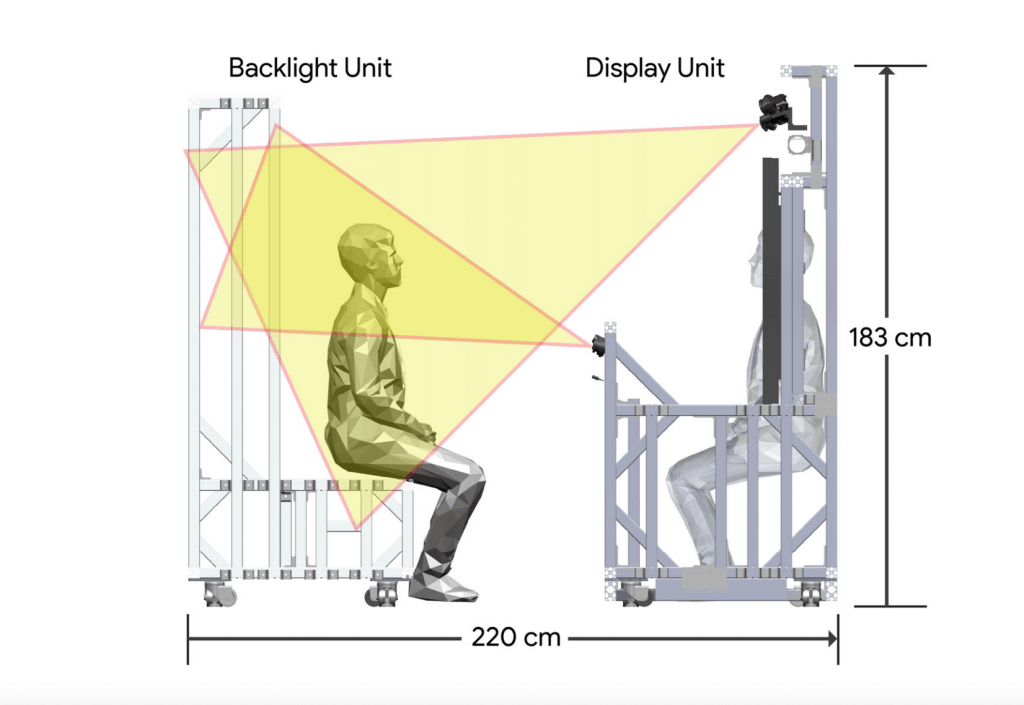

Foi nesse contexto que o Projeto Starline ganhou tração. Por meio de câmeras de alta resolução, além de sensores de profundidade que capturam o formato de uma pessoa, bem como múltiplas perspectivas para, então, criar um modelo 3D que consegue interagir em tempo real.

Legenda: imagem ilustra como o sistema do Projeto Starline captura uma pessoa para, então, transformá-la em um modelo 3D – Imagem: Reprodução/Google

A ideia é permitir uma experiência sensorial que dê a impressão de que a outra pessoa está ali, parada na sua frente.

“À medida que você movimenta sua cabeça e seu corpo, nosso sistema realiza o ajuste de imagens para corresponder à sua perspectiva. Você pode falar naturalmente, gesticular e fazer contato com os olhos”, afirmou Pichar, ainda durante o I/O deste ano.

Mas era apenas isso que a empresa tinha apresentado até então. O relatório de 16 páginas liberado na última quinta-feira (2) mostra os detalhes por trás do que eles mesmos chamam de “sistema de telepresença de alta fidelidade”.

O sistema consiste em uma display autoestereoscópico (que é um modelo de exibição que não exige uso de gadgets adicionais para funcionar corretamente, como um fone de ouvido, lentes, ou qualquer outro artefato) que rastreia os movimentos feitos pela cabeça dos participantes da videoconferência.

O principal desafio do Projeto? Enganar o cérebro humano

Não apenas a imagem precisa aparecer com profundidade, detalhamento e proporções que um ser humano de carne e osso apresentaria em uma conversa real, mas também o áudio precisa ser fiel à realidade – afinal, se você está esperando uma experiência em tempo real, seria bastante estranho ver a boca se mexer com atraso, como em uma dublagem de filme, não é mesmo?

Tudo foi pensado de forma que o cérebro humano não consiga registrar qualquer divergência que possa dar uma pista de que aquela imagem é virtual.

Para solucionar essa questão, a empresa utilizou uma tecnologia de “cancelamento de fala cruzada e monitoramento de cabeça”, para “criar a percepção de que o áudio se origina diretamente da boca do usuário remoto, mesmo quando ambos os usuários se movimentam”, explicam os autores do documento.

Com o intuito de garantir uma imagem fidedigna, o sistema foi construído com base em um grande painel 8K de 65 polegadas, que funciona a uma frequência de 60Hz.

O sistema também conta com quatro câmeras extras para rastrear movimentos, quatro microfones, dois alto-falantes e projetores infravermelhos. Ao todo, as imagens coloridas são capturadas de quatro pontos de vista diferentes para dar a profundidade necessária à reprodução, além de três mapas de profundidade e uma iluminação adequada.

Desenho do protótipo do Projeto Starline ilustra como seriam posicionados usuário, câmeras, monitor e participante remoto virtual para o funcionamento do sistema – Imagem: Reprodução/Google

Muitos dados por segundo

Como é de se esperar, um sistema desse, com todas essas informações que ele necessita para operar em tempo real, também requer uma tecnologia por trás que dê conta dos milhares de gigabytes por segundo que são criados em cada chamada.

Para garantir a reprodução de forma fluida, o Google teve de desenvolver uma tecnologia proprietária de compressão de vídeo que, ainda de acordo com Pichai, possui até 100 vezes a capacidade das ferramentas convencionais que realizam o mesmo processo.

De acordo com o documento, a largura de banda necessária para toda essa transmissão pode variar de 30 Mbps a 100 Mbps, dependendo de informações como “detalhe da textura nas roupas do usuário e da amplitude de gestos”.

A título de comparação: uma chamada em grupo convencional feita via Zoom, em HD de 1080p, necessita de 3 Mbps a 3,8 Mbps (upload/download). Ou seja, dá para ter uma noção de que o pré-requisito para rodar o sistema do Google é significativamente maior.

Mais a ser feito

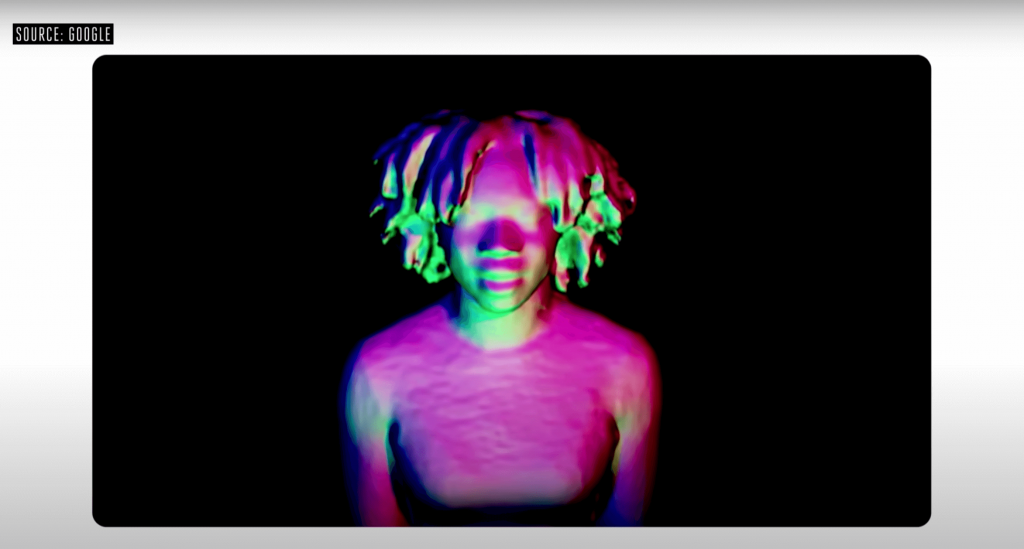

Apesar dos avanços consideráveis, os pesquisadores do Google ainda salientam que “geometria fina e semitransparente (por exemplo, cabelo e óculos), concavidades profundas e movimento rápido podem levar a erros ou buracos nos mapas de profundidade reconstruídos, resultando em uma geometria incorreta e erros de texturização”.

Como toda tecnologia, os especialistas afirmam que ainda há refinamentos que a empresa deve trabalhar durante os próximos anos.

Resta saber, agora, se a tecnologia estará disponível em breve para o público geral, driblando as barreiras que usuários comuns enfrentam para que o sistema funcione da mesma forma que a empresa demonstrou no início do ano. Ou se teremos algo mais a la Google Glass: incrível, porém não tão acessível assim para nós, meros mortais.

Comentários